Новая разработка американского IT-гиганта Google выглядит как технология двойного назначения. С одной стороны это находка для шпиона, который сможет выявить и подслушать говорящего на расстоянии, даже если тот прячется в толпе людей. С другой – прорыв в анализе голосовых данных поможет многочисленным инвалидам по слуху и повысит эффективность сервисов самой Google. Так как это работает?

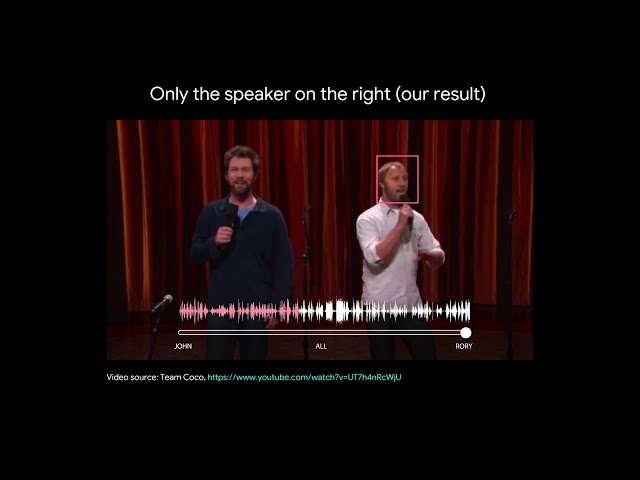

Распознать голос человека, даже при наличии помех, несложно – проблема в том, чтобы идентифицировать его обладателя. Разработчики Google просто приставили к микрофону видеокамеру с алгоритмом, который реагирует на мимику человека. Система сопоставляет движения на лице говорящего, «читает по губам» и параллельно анализирует звук. Если результаты совпадают – отлично, ИИ вычленяет этого персонажа и может следить только за его речью на фоне общей какофонии звуков.

Нейронную сеть сначала обучили самой технике чтения по губам, затем научили отличать людей говорящих от просто смеющихся, распознавать мимику при разговоре, даже если лицо частично скрыто бородой или микрофоном. Затем в систему добавили механизм сортировки – когда оратор вычислен, его данные поступают в отдельный акустический профиль. Благодаря этому ИИ может различать слова разных людей, даже если те специально стараются его запутать и говорят или поют в унисон.

Понимать разговор конкретной персоны – благое дело не только для соглядатая. Например, можно с большой точностью передавать на слуховой аппарат слова именно собеседника инвалида, отсеивая прочие голоса, как шум. Или расширить функционал видеочатов, вроде Hangouts и Duo. Плюс, это новые возможности для систем голосового управления, да и взломать защиту по голосу только при помощи фальшивой акустической записи теперь будет невозможно.

Источник — Google Research Blog

Источник: